Habla sobre la aplicación asesina.

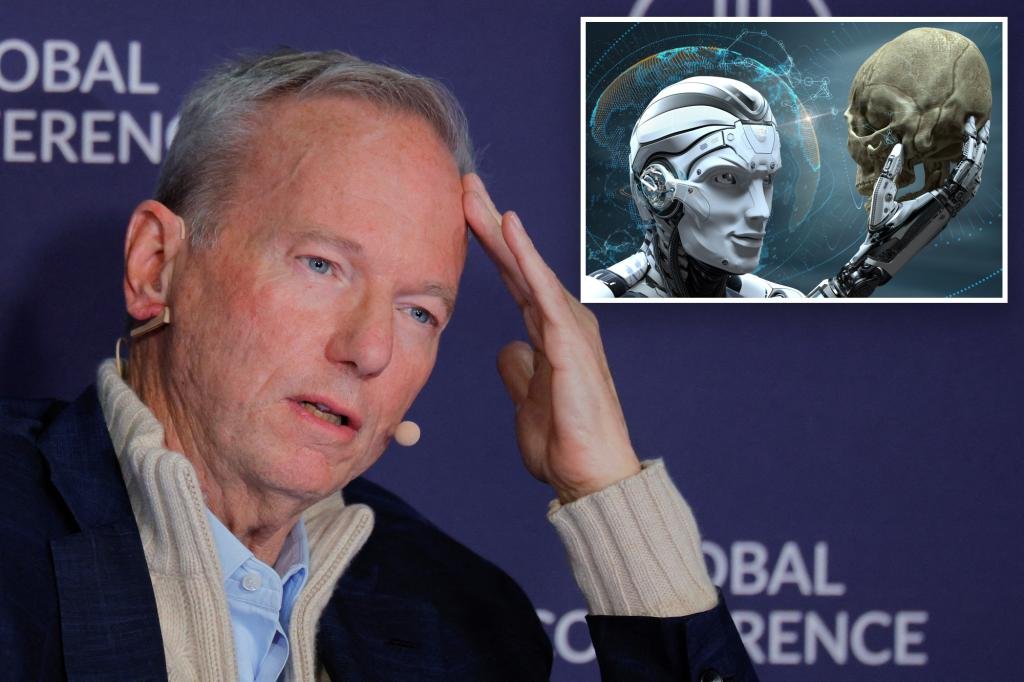

El ex director ejecutivo de Google, Eric Smith, advirtió que los modelos de inteligencia artificial están dirigidos a piratas informáticos y pueden entrenarse si los humanos caen en las manos equivocadas.

En la conferencia de Londres del miércoles se hizo una terrible advertencia en respuesta a la pregunta de si la IA es más peligrosa que las armas nucleares.

“Existe evidencia de que puedes tomar, cerrar o abrir las muestras, y puedes hackearlas para quitarles las protecciones. Así, aprenderán muchas cosas durante su entrenamiento. Según CNBC.

“A todas las grandes empresas les resultará imposible responder a esa pregunta sobre esos modelos”, afirmó, retransmitiendo la posibilidad de pedir a los usuarios que acaben con la IA.

“Buena decisión. Todos lo harán. Lo hacen mejor y por las razones correctas”, añadió Smith. “Existe evidencia de que se puede aplicar ingeniería inversa, y hay muchos otros ejemplos de esa naturaleza”.

Puede que las previsiones no sean tan lejanas.

En 2023, la CNBC señaló que se vio en línea la versión alterada del chatgipati de OpenAI: “Do Anthing Now”.

Don Alter Ego, creado por Chatzipity “Jail Breaking”, pasa por alto sus instrucciones de seguridad en sus reacciones a los usuarios. En un giro extraño, los usuarios primero tuvieron que amenazar de muerte al chatbot.

Smith, quien dirigió Google de 2001 a 2011, dijo que la industria tecnológica aún no tiene un “régimen de no propagación” efectivo para garantizar que los modelos de IA más poderosos no sean adquiridos ni abusados.

Es uno de los muchos grandes jefes de la tecnología que ha advertido sobre los efectos nocivos del desarrollo de la IA, mientras los gurús le han dicho a la sociedad los posibles beneficios económicos y técnicos para la sociedad.

En noviembre, Smith dijo que la creación de “novias perfectas” impulsadas por IA empeoraría aún más la soledad y la alienación de los jóvenes que prefieren su compañía a la de los humanos.

El multimillonario expondrá el “riesgo de existencialismo” para la humanidad en mayo de 2023, lo que puede llevar a que “muchas, muchas, muchas, muchas personas resulten dañadas o muertas”.

Ellon Musk, que se unió al juego de IA y Chatbot con Grocc y Xai, advirtió que había visto una “posibilidad distinta de cero de pasar a Terminator” en 2023.

“No es 0%” almizcle dijo. “Esta es una pequeña posibilidad de destruir a la humanidad, pero no es cero. Queremos que esa probabilidad sea lo más cercana posible a cero”.

A pesar de sus advertencias sobre los riesgos, Smith se mantiene firme respecto de los beneficios a largo plazo de la IA.

“Antes de morir, escribí dos libros con Henry Kissinger, y la llegada de la inteligencia extraterrestre no es nuestra y es muy grande para nuestro control, porque los humanos estamos acostumbrados a estar en la cima de la cadena”, dijo.

“Hasta ahora, el ensayo demuestra que el nivel de capacidad de estos sistemas ha excedido lo que los humanos pueden hacer con el tiempo”, añadió Smith.