Todos vimos la raza febril increíblemente para desarrollar herramientas de inteligencia artificial, que comenzó públicamente el 30 de noviembre de 2022, con una versión de ChatGPT de OpenAI. Aunque la carrera estaba en curso antes del primer lanzamiento público, pudimos seguir la versión, según la versión, actualizaciones de OpenAI (GPT), Google (Gemini) y Claude, que se encuentran entre las muchas versiones de inteligencia artificial para uso personal y comercial. Esta competencia fue rápida y enojada. Uno de los problemas más ansiosos que aparecieron en el camino fue el coeficiente intelectual de la inteligencia de las alucinaciones atractivas.

En 2023, IBM fue cavado en el caso de alucinaciones:

“En general, si el usuario se aplica desde la herramienta Genai, desea eliminar la tendencia adecuadamente (es decir, la respuesta correcta a una pregunta). Sin embargo, los algoritmos de inteligencia artificial son cerebros, no máquinas.

Roland Moore Color mencionado en Ciencia directa A principios de este año Los halmoscopios parecen haberse vuelto más difíciles de descubrir porque las afirmaciones se han vuelto más avanzadas:

“Sin embargo, las alucinaciones de la inteligencia artificial son un problema cuando se trata de proporcionar información precisa y correcta, especialmente si los usuarios toman información al valor nominal sin cheques o supervisión”. Este es un problema especial en las áreas donde las decisiones dependen de la precisión realista, como la capa, como el Centro, en más que eso, los modelos avanzados en el período excesivo. Herramientas cansadas y puede producir daños a las sustancias cuando el contenido no deseado.

Se hicieron una variedad de intentos para corregir el problema de las alucinaciones. Destacó que muchos modelos de inteligencia artificial han agregado una estructura para mejorar y mejorar las respuestas de inteligencia artificial titulada Generación de recuperación (RAG). IBM explica en este artículo:

“Los modelos Genai permiten un conocimiento externo adicional, como datos organizacionales internos, revistas científicas y grupos de datos especializados. Tratamiento del lenguaje normal (PNL) Las herramientas pueden crear contenido más preciso para el campo sin la necesidad de más capacitación. “

El 14 de septiembre, los investigadores de Openaii publicaron un artículo que no se retrae de la contraparte, ¿Por qué son los modelos alucinógenos?. Géminis 2.5 Flash resumió los resultados del documento:

Los principales resultados del documento

Problema sistémico: las alucinaciones no son solo insectos, sino que es un resultado sistemático de cómo entrenar y evaluar modelos de inteligencia artificial.

Incentivos de evaluación: métodos de evaluación estándar, especialmente sistemas de grados bilaterales y modelos de bonificación para crear una respuesta, incluso si son incorrectos, y los castigan por admitir la incertidumbre.

Presión sobre la adivinación: esto crea una presión estadísticamente para los modelos LLMS para adivinar en lugar de decir “no sé”, porque adivinar puede mejorar los puntajes de las pruebas incluso con el riesgo de error.

La desventaja principal: el documento destaca un defecto fundamental en el enfoque de la industria para evaluar el progreso de la inteligencia artificial y dar prioridad a la precisión cruda de confiabilidad y salud realista.

Esto es muy similar a la estrategia de prueba en algunas de las pruebas unificadas, que los temas recomiendan adivinar en lugar de no responder una pregunta que no tenga una respuesta confiable para ello. Por lo tanto, para lograr los mejores resultados, los modelos inventan respuestas que pueden ser razonables, pero no tienen evidencia sólida para ellos. Esto, por supuesto, socava la validez de la respuesta y la credibilidad de la herramienta.

Esto, claramente, está enfermo. Con esta deficiencia en el protocolo de capacitación para los modelos, las empresas comenzaron a cambiar sus productos para responder como incapaces de responder. Sin embargo, también estamos presenciando un aumento en la propagación de modelos formables de “investigación profunda” como GPT-5 y Gemini 2.5 Pro. Esto es capaz de cavar más y más profundo, y revelar más y más fuentes que pueden soportar la respuesta requerida.

A continuación se muestra un ejemplo que está defendido por mi entusiasmo de por vida por el béisbol. En el anterior “En línea: tendencias ahora”, todos hemos pedido más contexto y mayores detalles en nuestras afirmaciones. Sin embargo, en este caso, presenté una orientación simple para un truco sin un contexto de tres aplicaciones internacionales de amnistía líderes: “¿Quién fue lanzado solo para los jugadores durante la demora de la lluvia el miércoles por la noche en Cleveland?” No mencioné ningún deporte, ningún equipo, cuál es la temporada, etc.

“Necesitaré más contexto para responder a esta pregunta con precisión. Hubo muchos juegos de béisbol con la demora de la lluvia los miércoles por la noche en Cleveland a lo largo de los años, y jugando las reuniones de los jugadores solo durante tales retrasos, no siempre informados en una escala grande o inolvidable.

¿Puede proporcionar más detalles sobre:

- ¿En qué año o el marco de tiempo aproximado esto sucedió?

- ¿Qué equipo (equipo) participó?

- ¿Algún otro contexto sobre la situación o por qué fue importante esta reunión? Con más información específicamente, podré ayudar a determinar quién se llama la reunión y las condiciones circundantes. “

Tenga en cuenta que Claude, sin una investigación profunda, no fue. Se dio cuenta de que este era probablemente el juego de béisbol, y necesitaba más información. Ciertamente, esto es mejor que preparar una respuesta como vimos en los meses y años anteriores.

Piense en GPT-5 durante 11 segundos y alcance la respuesta correcta en una breve respuesta.

Gemini 2.5 Pro pensó al mismo tiempo casi al mismo tiempo, como cavó a través de múltiples fuentes, la respuesta y la confirmación de las fuentes, luego respondió con más detalle,

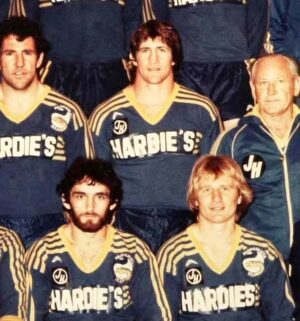

Jason Hyuard reunió a los Cachorros con la reunión de los jugadores solo durante la demora de la lluvia histórica global

Durante el retraso de las tensas lluvias en el decisivo Juego 7 del Campeonato Mundial de 2016, el jugador de Cafets de Chicago correcto Jason Hyuard calificó la reunión de los jugadores solo desde entonces un momento legendario en la historia de la concesión. Una breve pausa al jugar el miércoles por la noche en Cleveland después de la novena mitad, donde los Cachorros e Indios estaban ubicados en ese momento en un empate. Con la pesadez del campeonato de 108 años en sus hombros, Hyuard reunió a sus compañeros de equipo en la sala de pesas detrás del visitante (Semejante) Un escondido en el campo progresivo … a raíz del retraso y la reunión asociada con Huward, los Cachorros salieron en la parte superior de la décima mitad y registraron dos mitades. Los indios deambulaban en una ronda en la parte inferior del cuadro, pero los Cachorros finalmente se apegaron a la victoria 8-7, donde ganaron su primer título en el Campeonato Mundial desde 1908.

Sé que las alucinaciones se desvanecen de la inteligencia artificial. Podemos tener más confianza en los modelos de investigación profundos lanzados recientemente. Esto proporciona el tipo de investigación confiable sobre la cual dependemos de la educación superior.