Cuando compra a través de enlaces a nuestros artículos, el futuro y sus socios de sindicación pueden obtener comisiones.

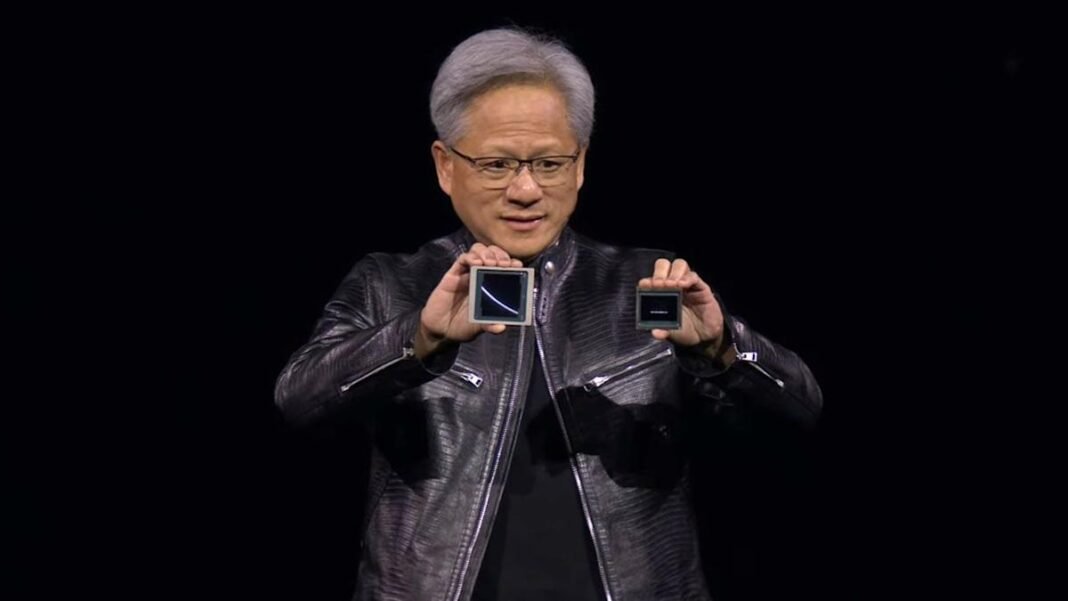

Un nuevo informe afirma que Amazon o Google informaron por primera vez al CEO de NVIDIA, Jensen Huang, antes de publicar algo sobre sus últimos chips de inteligencia artificial. Práctica, marcada por fuentes Información‘S Informe reciente sobre Nvidia Dilmaking internoAI Hardware dibuja una realidad tranquila del mercado: Nvidia todavía está tratando de no reducir los cálculos de capacitación y sus clientes no cortar.

Según el informe, Amazon y Google dieron un aviso anticipado a Huang antes de presentar sus actualizaciones de silicio personalizadas. Las fuentes dicen que la razón es que Nvidia todavía se ha incrustado profundamente en su actividad en la nube y no quiere sorprender a la persona que controla efectivamente su suministro de infraestructura de IA. NVIDIA explica los modelos de idiomas grandes para tener en cuenta la mayor parte de los excitadores utilizados para la capacitación, y sus GPU también manejan la parte creciente de la función de suposición en la nube pública.

El honor se produce desde que NVDIA ha sido de la misma manera que los clientes, proveedores y competidores mantengan el mercado de la misma manera. Solo en septiembre, NVIDIA ha firmado un acuerdo para comprar un poder GPU no utilizado de $ 6.3 mil millones de CoreWave durante los próximos siete años. Ha invertido $ 700 millones en la startup del centro de datos británico NSCL y ha gastado más de $ 900 millones para lograr una startup de redes de redes de redes e ingenieros originales mientras licen tecnología de chips. Que siguió a una noticia Invirtió $ 5 mil millones en Intel Un centro de datos de GPU de 10 Gigawat puede gastar hasta $ 100 mil millones para hacer una copia de seguridad de una carta de intención para desarrollar chips conjuntos y una carta de intens con OpenAi.

La escala y el tiempo de estas inversiones muestran cuán agresivamente NVIDIA está tratando de suprimir la aparición de aceleradores no GPU. Empresas como Amazon, Google y OpenAI están siguiendo los esfuerzos de silicona internos diseñados para reducir la dependencia del hardware NVIDIA y mejorar el costo de rendimiento o escala. A pesar de que tienen unos pocos miles de millones de dólares año tras año y detrás de ellos, sus plataformas aún dependen del ecosistema Nvidia Chuda, las herramientas de software y la tubería de producción.

Respectivamente InformaciónLa dominación de Nvidia ha creado una dinámica donde actúa como un respaldo financiero en toda la cadena de suministro de IA. La compañía ahora puede financiar a los proveedores, someterse a alquiler de energía y una compra a largo plazo para respaldar su continua demanda de su hardware. Hace que sea más difícil para un cliente distinto mudarse, incluso ellos fabrican productos competitivos.

De repente, los nombres más importantes de la computación en la nube todavía están informando a Jensen Huang antes de publicar sus próximas fichas. Este tipo de dinámica puede no durar para siempre, pero dice mucho sobre dónde está hoy.

Seguir Tom Hardware en Google News Para obtener nuestras noticias, análisis y revisiones actualizadas sobre sus feeds. Asegúrese de hacer clic en el siguiente botón.