Liv Mc MahonPeriodista de tecnología

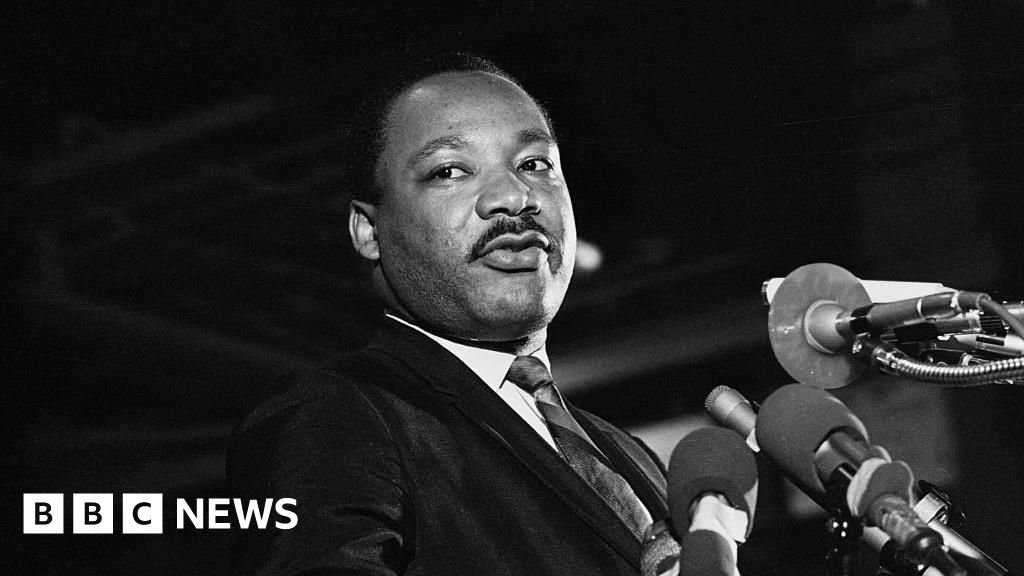

Archivo Bateman/Getty Images

Archivo Bateman/Getty ImagesOpenAI se detiene temporalmente Su aplicación de inteligencia artificial (IA), Sora, está creando vídeos falsos que representan al Dr. Martin Luther King Jr. a petición de sus herederos.

Dijo que se había producido material “irrespetuoso” sobre el activista de derechos civiles.

sora lo tiene Hazte popular en los EE. UU. Para crear videos hiperrealistas generados por IA, la gente comparte clips de celebridades y personajes históricos muertos en situaciones extravagantes y, a menudo, ofensivas.

OpenAI dijo que pausaría las imágenes del Dr. King “porque fortalece las barreras para las figuras históricas”, pero permite a las personas hacer clips de otros.

El presidente John F. La firma se ha enfrentado a una controversia sobre su postura después de que se compartieran ampliamente en línea videos de figuras notables como Kennedy, la reina Isabel II y el profesor Stephen Hawking.

Dirigida por Zelda Williams, hija de Robin Williams. Para pedirle a la gente que deje de enviar videos de su padre generados por IAFamoso actor y cómico estadounidense que murió en 2014.

La hija del difunto Dr. King, Bernice A. King, hizo más tarde una petición pública similar: Escritura en línea: “Estoy de acuerdo con mi padre. Por favor espera.”

Algunos de los vídeos generados por IA que mostraban al activista de derechos civiles habían editado de diversas formas su infame discurso “Tengo un sueño”. El Washington Post informa En un clip estaba haciendo ruidos racistas.

Mientras tanto, otros compartidos en la aplicación Sora y en las redes sociales mostraban figuras del Dr. King y su compañero activista de derechos civiles Malcolm X peleando entre sí.

permitir incógnita ¿Contenido?

La autora y especialista en ética de la IA, Olivia Gambelin, le dijo a BBC OpenAI que limitar el uso adicional de la imagen del Dr. King era “un buen paso”.

Pero dijo que la compañía debería haber tomado medidas desde el principio, en lugar de “ensayo y error a través de la manguera contra incendios” para desarrollar dicha tecnología.

Dijo que la capacidad de crear deepfakes de personajes históricos muertos no sólo muestra una “falta de respeto” hacia ellos, sino que también plantea mayores riesgos para la comprensión del público sobre el contenido real y falso.

“Se trata de un intento muy cercano de reescribir aspectos de la historia”, dijo.

‘Interés por la libertad de expresión’

El auge de los deepfakes (vídeos alterados mediante herramientas de inteligencia artificial u otras tecnologías para mostrar a alguien que no habla ni se comporta) ha generado preocupación de que puedan utilizarse para difundir información errónea, discriminación o abuso.

OpenAI dijo el viernes que si bien cree que existe un “fuerte interés por la libertad de expresión en representar personajes históricos”, ellos y sus familias deberían tener control sobre sus imágenes.

“Los representantes autorizados o los propietarios pueden solicitar que su imagen no sea utilizada en un cameo de Sora”, decía.

Los llamados “cameos” en la plataforma permiten a las personas vivas dar su consentimiento para que su rostro o imagen se utilice en videos posteriores de IA en Sora.

OpenAI dijo en una declaración a la BBC a principios de octubre que había “construido múltiples capas de protección para evitar abusos”.

Y dijo que tenía “comunicación directa con miembros del público y propietarios de contenido para recopilar comentarios sobre qué controles desean” con miras a reflejar esto en cambios posteriores.