Por Newly Purnell, Bloomberg

Anthropic PBC, que durante años se promocionó como una alternativa segura a sus rivales de inteligencia artificial, ha aflojado su compromiso de mantener sus barreras de seguridad, uno de los cambios de política más dramáticos en la industria de la IA, mientras que las nuevas empresas alguna vez ayudaron a la humanidad a centrar su atención en las ganancias y el éxito.

En 2023, la compañía dijo que retrasaría el desarrollo de IA potencialmente peligrosa en su política de escalamiento responsable. En una publicación de blog el martes, Anthropic dijo que estaba actualizando sus reglas y que ya no lo haría si creía que no tenía una ventaja significativa sobre un competidor.

“El entorno político se ha desplazado hacia la priorización de la competitividad de la IA y el crecimiento económico, pero las discusiones orientadas a la seguridad aún tienen que ganar un impulso significativo a nivel federal”, dijo Anthropic en su publicación.

La medida de la compañía subraya cómo los objetivos altruistas que guiaron a las nuevas empresas de IA en sus primeros años han chocado cada vez más con las presiones para ganar dinero y vencer a la competencia. OpenAI, Alphabet Inc. Anthropic está compitiendo por el dominio de la tecnología revolucionaria contra una serie de rivales formidables, incluidos Google de Google y xAI Corporation de Elon Musk.

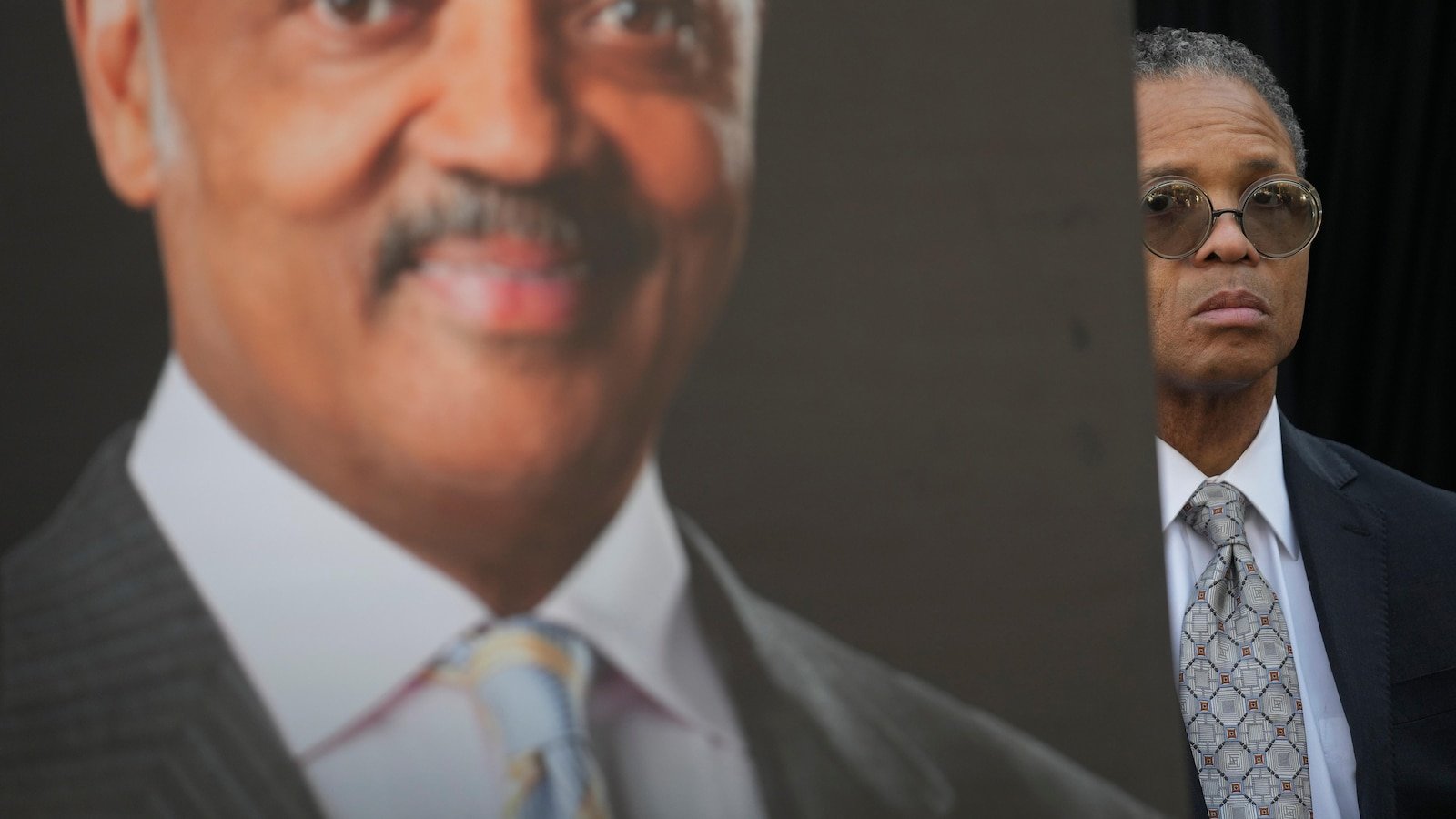

Dario Amodei, director ejecutivo de Anthropic, trabajó en OpenAI y se fue en 2020 en parte debido a su preocupación de que la startup estuviera priorizando la velocidad sobre la comercialización y la seguridad.

OpenAI comenzó como una organización sin fines de lucro y el año pasado pasó a ser una empresa con fines de lucro más tradicional. Actualizó su declaración de misión en 2024 eliminando la palabra “seguro” con el objetivo de garantizar que la inteligencia artificial general beneficie a la humanidad.

Ambas empresas están realizando ofertas públicas iniciales este año para aprovechar el interés de los inversores en la IA. Anthropic fue valorada recientemente en 380 mil millones de dólares, mientras que OpenAI está recaudando fondos por una valoración de más de 850 mil millones de dólares.

“Desde el principio, dijimos que la velocidad de la IA y las incertidumbres en el campo nos exigían iterar y mejorar las políticas rápidamente”, dijo un portavoz de Anthropic.

La política actualizada coincide con una creciente disputa con el Departamento de Defensa de EE. UU. sobre el impulso de Anthropic para el uso de su herramienta de inteligencia artificial en la nube. El Pentágono amenazó el martes con invocar una ley de la época de la Guerra Fría para obligar a Anthropic a utilizar la tecnología de la startup para el ejército estadounidense si la compañía no cumplía con las regulaciones gubernamentales antes del viernes.

En una reunión el martes entre Amode y el secretario de Defensa, Pete Hegseth, funcionarios estadounidenses expusieron una serie de ramificaciones, incluidas amenazas de declarar a Anthropic como un riesgo para la cadena de suministro e invocar la Ley de Producción de Defensa para obligar a la empresa a utilizar software de inteligencia artificial de todos modos, incluso si la empresa no está de acuerdo, informó Bloomberg.

A principios de este mes, Mrinank Sharma, un investigador senior de seguridad, dijo que dejaría Anthropic. “Estoy considerando constantemente nuestra situación”, escribió en una carta a sus colegas enviada a X.

“El mundo está en peligro”, escribió. “Y no sólo de la IA o las armas biológicas, sino de toda una serie de crisis interconectadas que se desarrollan en este momento”.

No respondió de inmediato a una solicitud de comentarios sobre el cambio de la compañía en su política de seguridad.

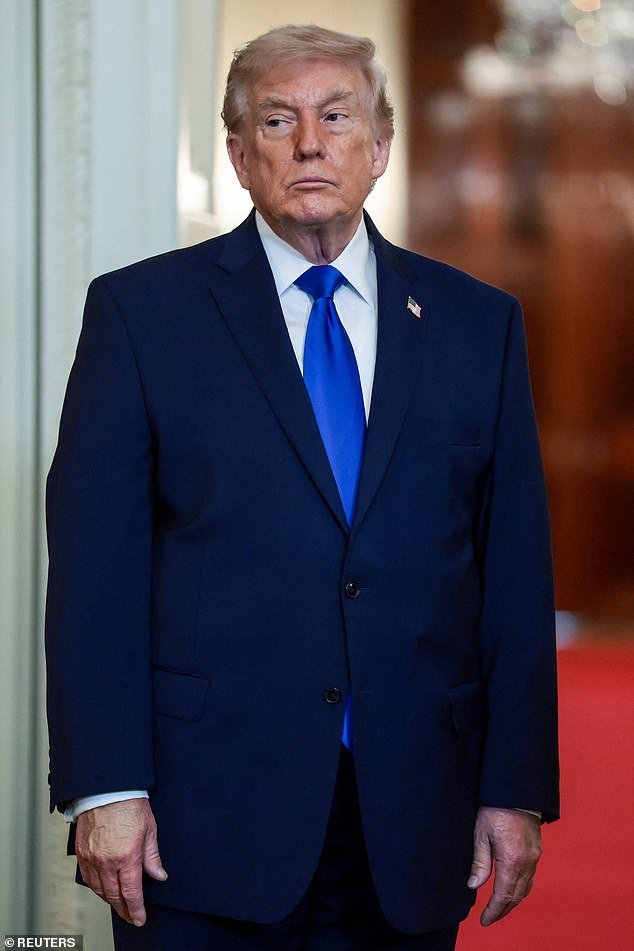

No son sólo Anthropic y OpenAI los que han luchado por adoptar medidas de seguridad adecuadas para la IA. A principios de este mes, Bloomberg informó que SpaceX de Elon Musk y su filial xAI están compitiendo en una nueva competencia secreta en el Pentágono para producir tecnología de enjambre de drones autónomos y controlados por voz, una salida potencialmente controvertida para Musk, quien se ha opuesto a fabricar “nuevos dispositivos que maten personas”. Musk incluso llegó a presentar una demanda contra OpenAI, que respaldó con decenas de millones de dólares con la esperanza de seguir siendo una organización sin fines de lucro comprometida con la creación de una IA segura para el beneficio público.

OpenAI también está apoyando una presentación de Applied Intuition en la competencia de drones, informó Bloomberg anteriormente, aunque OpenAI limitará su contribución al proyecto solo al componente de “control de misión” que convierte la voz y otras señales de los comandantes del campo de batalla en instrucciones digitales.

El conflicto entre Amode y el director ejecutivo de OpenAI, Sam Altman, a veces salió a la luz pública. Durante la Cumbre de AI en Nueva Delhi la semana pasada, los dos hombres se pararon uno al lado del otro con el primer ministro Narendra Modi y se negaron a tomarse de la mano mientras todos se alineaban en el escenario.

-Con ayuda de Vlad Savov y Lynn Doan.

(Actualizaciones con contexto adicional en todas partes)

Más historias de este tipo están disponibles aquí. www.bloomberg.com

©2026 Bloomberg LP